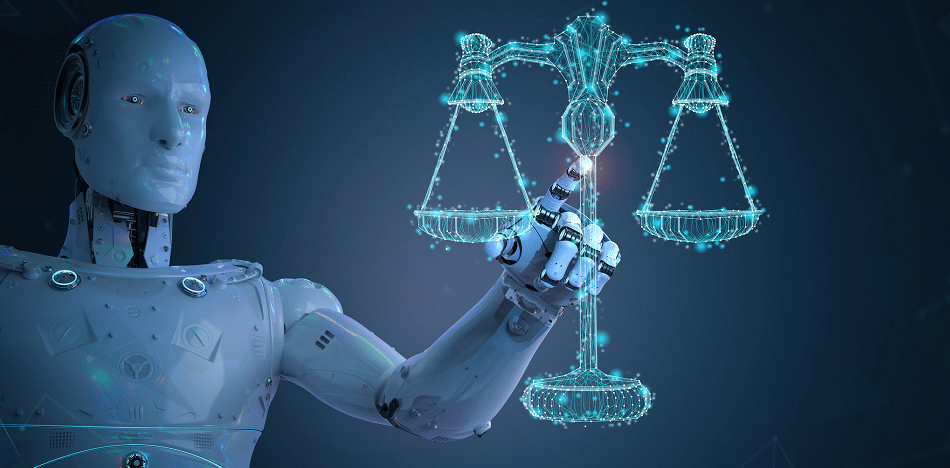

Hicieron falta 36 horas de discusiones para que la Unión Europea (UE) pactara una ley de inteligencia artificial que regule los avances de esta tecnología. Aunque falta que la ratifique el Parlamento Europeo y el Consejo de la UE, desde el organismo se percibe un aire de triunfo por una norma pionera en el mundo.

Para Thierry Breton, comisario europeo de Mercado Interior y Servicios, la norma “es mucho más” que un libro de reglas. A su juicio, “es una plataforma de lanzamiento para que las nuevas empresas y los investigadores de la UE lideren la carrera global de la IA”.

- Lea también: Cómo la inteligencia artificial siembra el caos en la guerra entre Israel y Hamás

- Lea también: Las insólitas canciones con inteligencia artificial (que pasaron inadvertidas)

Aunque es una novedad, la ley de inteligencia artificial podría quedarse atrás. Tanto así, que ni siquiera incluía a programas como ChatGPT, de OpenAI, porque en abril de 2021, cuando se propuso en Bruselas, ese tipo de programas aún no salían al público de la manera como lo hicieron a finales de 2022. Pero algo que destaca Ursula von der Leyen, la presidente de la Comisión Europea, es que se trata de “un marco legal único para el desarrollo de la inteligencia artificial en el que se puede confiar”.

Surgen preguntas y hay pocas respuestas

Mientras la ley de inteligencia artificial es ratificada, hay puntos delicados que vale la pena sopesar. Por ejemplo, la instalación de cámaras en espacios públicos para reconocimiento facial. La norma lo impide, pero tal como cita la agencia de noticias EFE, “los gobiernos han presionado para permitirlas en casos concretos, siempre con previa autorización judicial”. Por otro lado, el texto “genera dudas y algunas preguntas que los desarrolladores de la inteligencia artificial aún no saben responder, según fuentes conocedoras de los debates”.

Como resultado, hay mucha tela para cortar. Y mientras los humanos se ponen de acuerdo, los sistemas de inteligencia artificial alcanzan más espacios de la sociedad como lo hacen con el mundo de la música, de la pornografía y en términos mucho menos banales, en conflictos bélicos.

La guerra que escaló en octubre por el ataque del grupo terrorista Hamás a Israel ilustra este último punto. Las redes sociales se pusieron de cabeza cuando circuló una supuesta fotografía de un padre cargando a sus hijos tras un bombardeo en la Franja de Gaza. Pero la imagen fue creada con inteligencia artificial. Y si bien la violencia de esa guerra ha dejado escenas dantescas, también es cierto que algunas fueron creadas de forma anónima para exacerbar la indignación. Así abundan los casos, como las supuestas imágenes del expresidente Donald Trump siendo “arrestado” o el papa Francisco caminando por las calles del Vaticano con un abrigo similar al que usan artistas urbanos. Aunque pueden parecer iniciativas inofensivas, asoman lo que podría pasar si llegan más allá. Para abordar esa desinformación no hay medidas internacionales.

“Capturar un rayo en una botella”

Naturalmente, la regulación de la inteligencia artificial genera amplio debate y ha dado material para muchos análisis. Uno de estos pertenece a George Ford, un exprogramador y autor de ocho libros, para quien los gobiernos que pretenden controlar la IA para sus propios planes “bien podrían intentar capturar un rayo en una botella”.

Por otro lado, científicos que trabajan con IA mencionan el principio de precaución, que significa abordar medidas preventivas ante sospechas de tecnologías o productos que puedan generar daños a la sociedad. No obstante, la duda es cómo se puede regular una tecnología que no se sabe hasta dónde puede llegar.

Y para comprobar todo esto, un reporte de Reuters citaba que legisladores europeos se apresuraron a redactar regulaciones, incluso mientras empresas como OpenAI, con sede en Microsoft, continúan descubriendo nuevos usos para su tecnología. Es decir, esta nueva ley parece que apenas llega a alcanzar los avances de la inteligencia artificial.

English Version

English Version